من سنة بالضبط وفي وقت ما معلوماتنا كمبرمجين عن الـ AI كانت واقفة انه بيعرف يفرق بين صورة قطة وصورة كلب و شوية استخدامات بسيطة , خرج للنور ChatGPT وتبعه الكثير من ال AI Apps اللي كانت قادرة تنتج داتا جديدة أول مرة نشوفها وترد علينا زي ما الناس بترد علينا.

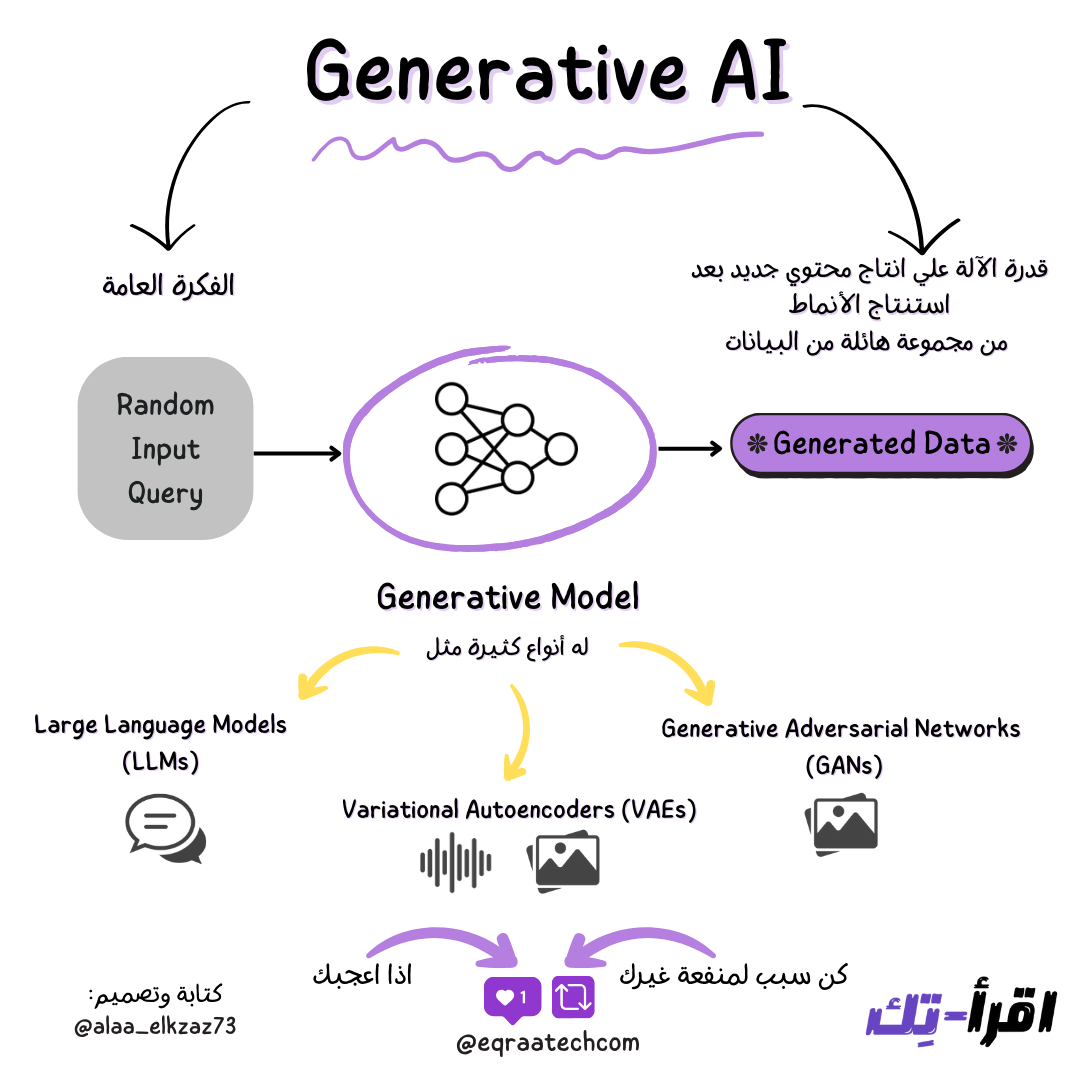

Generative AI

ال Generative AI هو فئة من فئات الـ AI اللي عندها القدرة على إنتاج محتوى جديد, سواء ردود على اسئلة أو صور أو مقاطع صوت أو فيديو ، وفي الواقع النوع دا من ال AI مش حاجة جديدة بل موجود من 1960 و احنا اتعاملنا معاه كتير قبل ChatGPt في هيئة ال Chat Bots ودي AI Apps قادرة تعمل محادثات زي البشر.

الـ AI Apps دي كانت محدودة المعلومات ومتقدرش تفهم كل الاسئلة اللي بتوجه لها ولا تقدر تفهم سياق المحادثة الكلي لأنها معتمدة علي Rule-Based Models ودي Models بيبرمج فيها الانسان قواعد وشروط ثابتة فتبدو كأنها بتنتج ردود ولكن الردود دي مبرمجة مسبقًا.

بينما ال Apps الجديدة اللي بنشوفها معتمدة على تقنيات مختلفة ومرنة من ال Deep Learning Models واللي محتاجة برمجة أقل ولكن Data Sets اكبر بكتير عشان تتدرب عليها وكل لما البيانات اللي كانت بتتدرب عليها أكتر ومتنوعة أكثر كانت ال Models دي اقوي وبتدينا نتائج أحسن من غير برمجة ثابتة للردود دي.

أشهر الـ Models

أشهر ال Models اللي بنستخدمها حاليًا في ال Generative AI:

- Large Language Models (LLM) ودي اللي بنستخدمها في ChatGPT و محركات الترجمة و التلخيص

- Generative Adversarial Networks (GANs) و دي اللي بنستخدمها في إنتاج الصور و الفيديوهات

طيب ما برضو ال Deep Learning Models مش حاجة جديدة, امال ايه اللي عمل الطفرة دي؟

ايه الاختلاف اللي أدى لظهور الـ Generative AI

دا يعود لـ3 أسباب رئيسية:

1- اكتشاف الـ Transformers Models 2017

ودي نوع من ال Neural Networks اللي قادرة تتعلم سياق أو مضمون الجملة ودا مهم جدًا لفهم أي لغة بشرية مش بس تربط الكلمات ببعضها وتشوف تكرروا كام مرة زي الموديل العادي وبتستخدم في دا فكرة رياضية بسيطة اسمها ال Self Attention واللي بتحسب ارتباط الكلمة بنفسها وبغيرها في الجملة وبكدا تقدر تربطها بالسياق و تشوف الضمائر العائدة عليها. استخدام ال LLM لل Transformers خلي كفائتها اعلى واسرع بكتير.

2- تواجد كميات هائلة من البيانات على الإنترنت يمكن للـ Model التدرب عليها

جودة النتائج اللي بتنتجها الـ Models بيتناسب مع كمية واختلاف البيانات اللي اتدربت عليها , دلوقتي في Tera-Bytes من البيانات المختلفة في اي مجال متاحة علي الانترنت و نقدر نستخدمها في التدريب واللي حسًن الأداء بشكل كبير جدًا.

3- التطور الكبير في الـ Hardware

الموديل بيتكون من عدد مهول من المتغيرات وعشان يشتغل ويتدرب على الكمية الهائلة دي من البيانات محتاج Hardware قوي جدًا يشتغل باستمرار لساعات طويلة ودا مكلف للغاية, فمع التطور الهائل في ال Electronic Chips دا اصبح ممكن بتكاليف مش قليلة ولكن مقدور عليها.

الختام

في صناعة البرمجيات مهم نكون عارفين أسباب التطور في التقنية اللي حوالينا وحصل ازاي عشان نعمل تقييم سليم للتقنية مننبهرش بيها ولا نقلل من حجمها, ونقدر نستغل مميزاتها ونتفادي العيوب الحالية

من مميزات ال Generative AI أنه بعد تدريبه تقدر تستخدمه في تطبيقات كثيرة جدًا تقدر تسأل ChatGPT عنها، ولكن من عيوبه انه لو متعملوش Fine Tuning ممكن يطلع داتا فيها مشاكل أخلاقية أو متحيزة لجهة معينة وكلنا عارفين انه ساعات بيفبرك بعض المعلومات ويقدمها كحقائق.

المصادر

https://www.techtarget.com/searchenterpriseai/definition/generative-AI

Discussion